我家老妈就是个活生生的例子。前阵子我给她买了一台智能手表,本意是监测一下心率和睡眠。结果老太太倒好,每天盯着APP里那些跳动的数字看,血压高了心慌,血压低了她也慌,反倒比不看的时候焦虑多了。打电话给我抱怨了半个小时,说这破玩意儿只会记数字,也不会告诉我该咋办。我当时心想,妈您要的不就是个随叫随到、能看懂您那些数据的健康顾问吗?

后来我把她手机里自带的AI健康助手打开了。嘿,您猜怎么着?老太太现在跟那APP处得比我亲多了!每天早上起来第一件事,不是看家族群里的养生段子,而是打开助手看昨晚的睡眠报告。什么时候深睡多久、心率有没有异常波动,全都给分析得明明白白。更绝的是,她前两天还跟手机对话说自己头晕,那个助手不但告诉她可能是血压波动的信号,还直接给她推荐了附近社区医院的预约通道。挂完电话我妈给我来了句,这东西比你去学的那些营养知识管用多啦。得,我在亲妈心里的地位彻底被AI取代了。

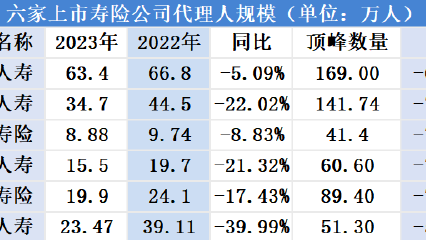

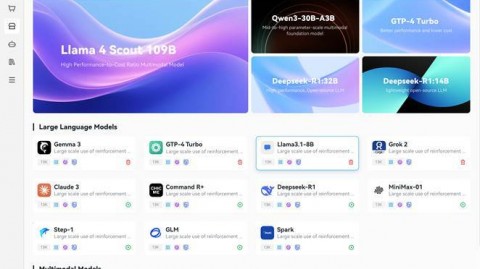

说实话,我妈这种心态转变,其实特别能说明问题。现在市面上随便一搜,各大巨头都在往AI健康这条赛道上冲。百度弄了个“文心健康管家”,定位是24小时待机的全能家庭医生,据说是学了一千六百万条权威科普数据,什么文字、语音、图像全能识别,而且是一天一迭代,超百万的隐私脱敏数据练出来的底子-9。腾讯健康就更讨巧了,直接嵌在微信里——我身边好多中老年人其实根本搞不明白APP在哪下载、怎么注册,但谁还不会用微信呢?人家在“我-服务-医疗健康”里面一站搞定,还能帮父母建个家庭健康档案,我在外面上班随时能看到他们的体检趋势变化-13。这些AI健康助手现在已经不是过去那种你问一句他答一句的“问答机器人”了,正在往主动帮你想事儿的方向进化。

但我这人吧,凡事爱刨根问底。光有这些故事还不够,我花了一个周末的时间,把市面上几款主流产品都翻了个底朝天。有几个发现想跟你聊聊,可能会帮到正在纠结要不要用这些工具的家人。

AI问我答,靠不靠谱这个事儿,我拿权威测评说话。

我发现一个挺有意思的现象。

但你也别把AI当神医,目前市面上的大部分AI健康助手,说白了就是一个非常能聊的智能对话体。它很擅长使用医学原理,但它的信息源来自公开资料。这一点很重要:

所以结论是什么?

聊到隐私和安全这个话题,说实话我也挺在意的。

谁都不想自己哪天去医院做了个检查,第二天手机上就全是相关的广告推荐。我专门查了一下,国家对这个领域管得其实挺严的。2025年底,国家卫健委等部门专门出了一个意见,强调AI应用要保障数据安全,坚持“赋能而不替代”的定位-26。网络安全法也在2026年1月开始施行,对个人信息保护这块有了更明确的约束-。

从企业层面来看,几大互联网公司在这块也没少下功夫。就拿百度文心健康管家来说,他们明确宣称学习了超过百万的隐私脱敏数据,还有一套红线风险校验体系-9。蚂蚁阿福那边也接入了苹果、华为、小米这些主流品牌的智能穿戴设备,但你需要主动授权才能共享数据-。总的来看,只要你是从正规官方渠道下载的这些主流健康助手,在数据安全方面它们是有基本保障的。但还是那句话,别在上面填任何不必要的敏感信息,比如身份证号和具体的家庭住址,这点常识咱们得有。

再来说说这些AI健康助手凭什么就这么能说会道?它背后到底是咋运作的?

你要知道,这些产品可不是随便编出来的,背后是真实的数据和人工核验在撑着。蚂蚁阿福上线不到半年,月活用户就干到了三千万,每天要回答上千万个健康问题-42。百度的文心健康管家走的是 “AI生成+真人核验” 的路线,识别准确率据说超过95%,覆盖了轻症咨询到复杂疾病的规划,背后还联动着36万名公立医院的医生-1-9。腾讯那边也是一样,不光能拍照识别你的体检报告,直接给你生成分析图表,还打通了五千家公立医院的挂号预约,让你从咨询到就诊一气呵成-13。

此外还有一个非常有意思的融合趋势:AI健康助手与智能穿戴设备的强强联合正在从概念走向现实。小米运动健康的APP已经接入了蚂蚁阿福,你在睡眠监测和心率监测的界面直接点击一下,AI就能给你分析数据,告诉你那些心率波形背后的含义,以及作息规律该如何优化-42。华为这边也跟进了,鸿蒙系统的小艺Claw能够基于智能手表记录的步数、压力值、热量消耗等数据,在手机里自动生成日报,并给你规划出下周的运动计划,甚至能自动同步到你的手机日历里去-49。未来的场景就是——AI不再是坐着等你去提问的被动工具,而是根据你身上的可穿戴设备主动给你发消息,提醒你该动一动了,或者告诉你今天的心率变异性有点异常。

最后给想尝试这些AI健康助手的你,提几个实用的避坑建议。

第一,别一上来就信它说的所有东西。遇到它给你的用药建议,尤其是什么“这个偏方可以试试”,一定要再找专业的医生复核一遍。第二,你最好找一个能接入你智能手环、能看运动数据的健康助手,这样它的分析才有根基。第三,别偷懒用微信里的不靠谱小程序,直接去各大手机应用商店下载蚂蚁阿福、百度文心健康管家这些经过市场验证的头部产品。尤其要注意,千万别在那些来路不明的“健康管家”上面输入你的私密健康信息。

作为一个真实使用者,我现在的习惯是:平时遇到小毛病先用它查一查、做个评估,判断一下需要去医院还是可以自己调理;收到了体检报告后拿它做个预分析,心里有个数再去找医生,方便沟通;平时还会让它结合我的手环数据,分析一下近期的睡眠质量和运动量够不够。至于那些让我心里没底的信息——特别是跟“特效药”和“根治某病”有关的,我一定会去二次核实,从来不轻信。

说句实在话,现在的健康AI助手就像咱们小时候感冒了,妈妈先给你熬一碗姜汤——它能帮你应对绝大多数普通场景,但如果真是肺炎,那还是得赶紧上医院。关键在于找到你心里那个平衡点:既不完全依赖它,也别彻底抗拒它,把它当做一个降低健康决策门槛的好帮手,而不是能救命的“神仙工具”。

好了,关于AI健康助手这个话题,我的大实话就说到这儿。

我看后台已经有不少网友在留言了,我来挑三个有代表性的问题,挨个跟大家好好聊聊。

网友“用户已注销1124” 说:“小编你说的这些产品我都用过,确实方便。但我就想知道,这些AI健康助手每次回答问题时,它的答案来源到底是什么?我怎么判断它说的是对的还是瞎编的?”

这个问题问得太好了!说实话这也是很多人心里最大的疙瘩。

这些AI健康助手背后的知识来源,其实是相当庞杂和多层次的。拿行业里做得比较深的百度文心健康管家来说,他们累计学习了1600万条权威科普内容、300万份多模态医学素材,以及超过1亿条诊疗逻辑数据-9。也就是说,你在百度上的健康类权威文章、三甲医院的医生科普视频、医学教科书的内容,包括一些真实的临床病历逻辑,都会作为训练数据喂给AI模型。

那为什么有时候AI还会“胡说八道”呢?我跟你掰扯一下这里面的门道。

目前的AI大模型有一个特性,叫做“概率预测”——它在回答你的问题的时候,其实是根据之前学过的海量内容,去计算“在当前的语境下,哪个回答出现的概率最高”。所以它并不是在“理解”一个问题的医学真相,而是在“预测”最有可能符合医学常识的一句话。这就导致了一个潜在问题:如果某一种疾病或者某个药物的网络讨论里,包含了大量夸大其词的软文或者不靠谱的网页,AI在训练过程中也会学到这些内容。一旦某个用户问的问题触发了相关的上下文,AI就可能引用这些不靠谱的信息。

这也解释了为什么有些测评里发现部分AI健康助手会推荐一些“特效药”——其实不是它故意坑你,而是它读到的内容里,这类软文的密度和权重太高了-35。

所以怎么判断它说的对不对?我给你一个非常实用的方法:凡是它给出的明确的用药建议、治疗方案、诊断结论,你一定要去二次核实。你可以把AI的结论复制到引擎里,找几个权威的、有医生认证的网站看一看,或者直接挂一个线上的图文问诊,跟真实医生确认一下。也别因为某一次它说错了就彻底否定它——在健康信息科普、基础的分诊指引、体检报告的初步解读这几个维度上,它的准确率已经比过去高了很多。

网友“夜雨声烦-小苏” 留言:“小编,你说得天花乱坠,但我担心的是另外一件事。我爸妈不太会用智能手机,有时候连打字都不会,我妈只会发语音,我爸只会看短视频。这些AI健康助手对中老年人真的友好吗?他们能正常用起来吗?”

哎呦,这个问题太真实了。我太了解这种焦虑了,因为我妈就是这个画像的典型代表。

不过我可以非常负责任地告诉你,现在的AI健康助手在“降低使用门槛”这件事上,已经有了很大的进步。先说语音这个刚需——蚂蚁阿福早就支持了语音和文字两种提问方式,而且它是能听懂方言的。你没听错,不只是普通话,你老家那种“川普”或者“粤普”,它基本都能识别的-14。我老母亲用河南话问“我头晕咋办”,助手照样能给出一套靠谱的分析和建议。

另一个改变是,这些产品正在变得越来越“不挑设备”。腾讯健康聪明地把入口直接嵌入了微信里面,你只需要教会爸妈在微信的“我-服务-医疗健康”这个路径里找到它就行,不需要额外下载任何东西,更不需要学新App的操作逻辑-13。

但我觉得最厉害的,是“家庭健康档案”这个功能的落地。腾讯健康的小程序就首创了家庭场景的健康档案,支持用户代管父母和孩子的健康档案。比如说你在外地工作,可以在自己的手机上帮爸妈建立档案,把他们的体检报告、用药记录、过往病史都放进去。需要的时候,你可以在微信家庭群里把AI的分析结论一键分享给他们-13。我上周刚帮我妈把她的血压记录和我给她买的手环数据做了同步,每天早上的血压测量结果会自动上传到健康档案里,然后AI生成一个简单的趋势图表发到我手机上。你说,这对我们这种在外打拼的子女来说,是不是一种实实在在的安心?

所以在给爸妈用这件事上,别怕他们学不会。你只需要做两件事:第一,帮他们把手机上的权限设置好,把入口放到桌面最显眼的位置;第二,远程帮他们完成第一次数据同步和档案创建。剩下的交给语音交互就够了。

网友“数据恐惧症晚期” 问出了很多人的心里话:“小编你说的这些我都信,但最让我害怕的是——我每天在哪睡觉、心率多少、走了多少步、吃了什么,这些东西全都上传到云端了。这些隐私数据安全吗?有没有可能被泄露或者被卖给保险公司?”

说实话,你这个问题直接戳到了AI健康助手目前面临的最核心的矛盾之一:用户希望获得个性化的精准分析,但个性化又必须以共享个人隐私数据为代价。

我先给你吃一颗定心丸——国家层面已经在这个领域建立了一整套相对严密的监管框架。2026年1月,最新修订的网络安全法正式施行,对个人信息保护的要求比以往更加严格,任何企业如果未经用户明确授权就收集或者出售健康数据,面临的处罚力度是非常大的-。与此同时,国家卫健委等部门明确提出,AI健康应用必须坚持“赋能而不替代”的定位,在数据安全和个人信息保护方面有一整套规范性要求,要确保数据“安全、可靠、可控”-。

从企业角度来看,我比较了目前几家主流产品的隐私保护做法,发现它们基本都走的是同一条路:隐私脱敏处理。什么意思呢?就是在AI模型训练和分析的时候,你的名字、身份证号、精确地址这些能直接指向个人的信息会被剥离或者加密,只保留那些统计学上需要的数据字段。百度文心健康管家就明确宣称,他们的模型经过了超过100万隐私脱敏数据的学习和超过10万条红线风险集的校验-9。也就是说,就算有黑客或者内部人员能接触到这些数据,看到的也只是一个编号,没法跟你的真实身份对应起来。

不过我必须坦诚地说,没有任何系统是绝对安全的。万一企业自身的安全防护被攻破,或者出现了内部管理漏洞,风险依然存在。

所以我的建议是:使用这些AI健康助手的时候,要学会做减法。你只需要提供那些必要的、帮助你获得个性化建议的数据就行,比如身高、体重、心率趋势、睡眠时长、运动量。像具体的家庭住址、身份证号、银行卡号这些东西,在任何健康APP上都不要填。另外,对于那些小众的、没怎么听过名字的“健康助手”,保持高度警惕,尽量选择蚂蚁、腾讯、百度、华为这些大厂出品的产品。在数据安全这件事上,大厂至少愿意投入资源去做合规和防护,小众产品就很难说了。

总的来说,AI健康助手带来的便利性和个性化服务,确实是以一定程度的数据共享为代价的。关键在于你自己要权衡这个利弊——如果你只是偶尔用它查一下感冒咳嗽之类的基础信息,那你完全可以关闭所有的健康数据同步权限,把它当一个纯粹的问答工具来用。只有当你希望它帮你做深度分析、给出个性化的运动建议或者预警潜在的健康风险时,才需要开放更多的数据。把选择权牢牢握在自己手里,别稀里糊涂地点了“同意所有权限”。