本文发布于北京时间2026年4月10日,内容基于2026年最新行业数据与技术进展编写。

AI结合语音助手:2026技术架构与实现全解析

一、开篇引入

如果说2025年是AI大模型从“文本对话”迈向“多模态交互”的元年,那么2026年,AI结合语音助手正成为这场变革中最具想象力的落地方向之一。根据2026年最新行业报告,语音助手应用市场规模将从2025年的72.1亿美元增长至2026年的96.2亿美元,年复合增长率高达33.5%-。与此同时,AI语音代理市场预计从2024年的24亿美元增长至2034年的475亿美元,AI语音投资在一年内飙升了8倍-7。

绝大多数开发者和技术学习者面临的痛点是:会用市面上已有的语音助手产品,却不懂背后的技术原理。ASR(Automatic Speech Recognition,自动语音识别)、LLM(Large Language Model,大语言模型)、TTS(Text-to-Speech,语音合成)各自独立,但串在一起到底怎么工作?为什么有些语音助手响应延迟只有几百毫秒,有些却让人等到抓狂?“全双工交互”和“半双工交互”又有什么区别?这些问题,如果你只是调用API,很难真正理解。

本文将从痛点切入 → 概念拆解 → 架构演进 → 代码示例 → 底层原理 → 面试考点六个维度,带大家系统掌握AI结合语音助手的技术体系。

二、痛点切入:传统语音交互的“三宗罪”

2.1 传统实现方式

在AI大模型普及之前,传统语音助手主要依赖“关键词唤醒 + 规则引擎”的架构:

传统语音助手的简化逻辑 def traditional_voice_assistant(user_speech): 1. 唤醒词检测(仅当听到"Hey Assistant"时才激活) if "hey assistant" not in user_speech.lower(): return 不响应 2. 关键词匹配(有限指令集) if "weather" in user_speech: return get_weather() elif "play music" in user_speech: return play_music() elif "call mom" in user_speech: return make_call("mom") else: return "Sorry, I don't understand that command." 超出门槛后直接失败

2.2 三大核心痛点

这种传统方案存在三个致命问题:

交互割裂:必须先喊唤醒词再说指令,用户无法像自然对话一样流畅交流-43。

语义理解能力薄弱:依赖有限的关键词匹配,遇到“帮我看看明天要不要带伞”这类自然表达就直接“听不懂”。

无法处理多轮对话:用户问“今天天气怎么样?”得到答案后追问“那后天呢?”——系统根本不记得上一句说了什么,体验极其割裂。

2.3 新方案的必然性

正是这些痛点,催生了 “ASR → LLM → TTS”的级联架构,让语音助手第一次拥有了真正的“理解”能力——不再是听关键词,而是听懂语义,记住上下文,完成复杂任务。

三、核心概念讲解:ASR、LLM与TTS

3.1 ASR——语音识别(耳朵)

ASR(Automatic Speech Recognition,自动语音识别) ,是将人类语音信号转换为文本的技术。

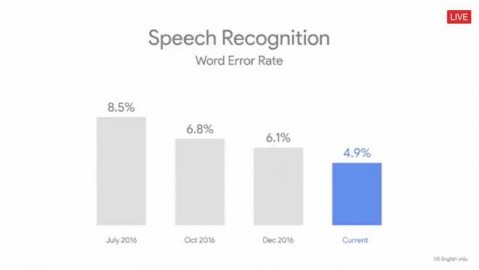

如果把AI语音助手比作一个人,ASR就是它的“耳朵”——负责捕捉声音,并把声音“听写”成文字。其核心技术路径包括:声学模型识别发音单元(音素)、语言模型判断词序列概率、解码器综合推理出最优文本-16。

2026年的ASR技术已经能够支持流式识别,即边说话边转写,无需等待用户说完才开始处理。

3.2 LLM——大语言模型(大脑)

LLM(Large Language Model,大语言模型) ,是经过海量文本训练、具备理解与生成自然语言能力的深度神经网络。

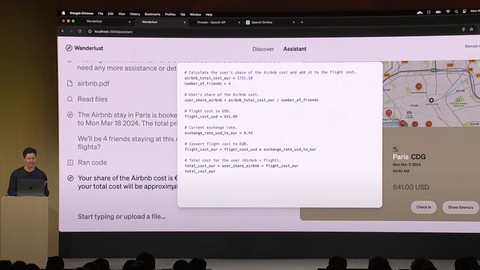

它是语音助手的“大脑”——接收ASR输出的文本,理解用户意图,结合对话上下文,生成合理回复。例如,用户说“帮我订一张明天去上海的高铁票”,LLM会理解这是“订票”意图,并提取出“明天”、“上海”、“高铁”等关键信息。在2026年的成熟方案中,LLM通常还会配合Function Calling(函数调用)能力,实现与外部API的对接,让助手不仅能“听懂”,还能“办事”-53。

3.3 TTS——语音合成(嘴巴)

TTS(Text-to-Speech,语音合成) ,是将文本转换为自然语音输出的技术。

它是语音助手的“嘴巴”——把LLM生成的文字回复“读”出来。2026年的TTS技术已经能够模拟呼吸感、情绪波动,甚至支持多语言、多音色的拟人化表达。优秀的TTS方案通常能将合成延迟控制在75毫秒以内-9。

四、关联概念讲解:级联架构 vs 端到端架构

4.1 级联架构(Cascading Architecture)

定义:将语音交互拆解为ASR → LLM → TTS三个独立模块,各模块通过流式管道串联协作的架构模式-24。

核心特征:模块独立、可替换、可单独优化。ASR可用不同的语音识别引擎,LLM可替换为不同的模型,TTS可独立升级音质。

4.2 端到端架构(End-to-End Architecture)

定义:使用单一神经网络模型直接完成从语音输入到语音输出的全链路转换,无需中间文本显式转换-24。

核心特征:统一建模、潜在延迟更低、能保留副语言信息(如语气、停顿)。

4.3 对比总结

| 维度 | 级联架构 | 端到端架构 |

|---|---|---|

| 技术成熟度 | ✅ 高,各模块独立优化,便于调试 | ⚠️ 较低,仍在快速演进 |

| 可解释性 | ✅ 强,中间结果可查看 | ❌ 弱,黑盒效应明显 |

| 延迟 | ⚠️ 三者累加,约0.8-1.2秒 | ✅ 更低,可减少约300ms |

| 数据需求 | ✅ 适中 | ⚠️ 5-8倍于级联方案 |

| 上下文保持 | ⚠️ 存在信息损失 | ✅ 优秀,保留语气/停顿 |

| 模块灵活性 | ✅ 高,可任意替换组件 | ❌ 低,模型耦合度高 |

一句话总结:级联架构是“三个专家接力完成一项任务”,端到端架构是“一个全能选手独立完成” 。目前多数生产级语音系统采用混合策略——以级联架构为基础保证稳定性与可控性,同时在特定场景探索端到端方案的潜力。

五、代码示例:构建一个简易的AI语音助手

下面是一个基于Python实现的核心逻辑示例,演示ASR → LLM → TTS的完整级联流程:

import asyncio from typing import Optional 模拟三种核心服务(实际开发中需要替换为真实API) class MockASR: """语音识别模块:将音频转文本""" async def transcribe(self, audio_bytes: bytes) -> str: 模拟ASR处理耗时 await asyncio.sleep(0.15) 实际场景:调用Deepgram/Whisper API return "今天天气怎么样" class MockLLM: """大语言模型模块:理解意图并生成回复""" async def generate(self, prompt: str, context: list) -> str: await asyncio.sleep(0.35) 实际场景:调用OpenAI/通义千问等LLM API 结合上下文(context)维护多轮对话 return "今天北京晴,气温18到25度,适合户外活动。" class MockTTS: """语音合成模块:将文本转语音""" async def synthesize(self, text: str) -> bytes: await asyncio.sleep(0.2) 实际场景:调用ElevenLabs/CosyVoice API return b"fake_audio_data" class VoiceAssistant: """级联式语音助手主控模块""" def __init__(self): self.asr = MockASR() self.llm = MockLLM() self.tts = MockTTS() self.conversation_context = [] 多轮对话上下文存储 async def process(self, audio_input: bytes) -> Optional[bytes]: 步骤1: ASR转写 user_text = await self.asr.transcribe(audio_input) print(f"[ASR] 用户说: {user_text}") 步骤2: 将用户输入加入上下文 self.conversation_context.append({"role": "user", "content": user_text}) 步骤3: LLM生成回复(传入上下文) assistant_text = await self.llm.generate(user_text, self.conversation_context) print(f"[LLM] 助手回复: {assistant_text}") 步骤4: 将助手回复加入上下文 self.conversation_context.append({"role": "assistant", "content": assistant_text}) 步骤5: TTS合成语音 audio_output = await self.tts.synthesize(assistant_text) return audio_output 运行示例 async def main(): assistant = VoiceAssistant() audio_input = b"user_audio_data" response_audio = await assistant.process(audio_input) print("语音回复生成完成") asyncio.run(main())

关键设计要点:

模块化封装:ASR、LLM、TTS各自独立,可单独替换或优化

上下文管理:

conversation_context存储历史对话,实现多轮交互流式传输:实际生产系统中,三个模块会采用流式API并行处理,而非串行等待

需要说明的是,真正“实时”语音交互的关键不在于任何一个单独模块的速度,而在于跨组件的流式传输与流水线并行。最新研究表明,采用流式STT → 流式LLM → 流式TTS的级联方案,可以在搭载NVIDIA A10G GPU的服务器上实现947毫秒的首音频时间(P50)-10。对于绝大多数对话场景而言,1秒以内的响应延迟已具备可用性。

六、底层原理:语音助手的技术根基

AI结合语音助手的底层运行,依赖以下核心技术支撑:

6.1 唤醒词检测(Keyword Spotting,KWS)

传统方案:使用轻量级神经网络(如DNN、CNN)在设备端实时监听音频流,功耗可控制在10mW以下。局限性在于需要预设关键词,且易受环境噪音干扰-43。

2026年演进方向:借助边缘AI芯片(如NPU)与Tiny Transformer等高效模型,设备可实现低功耗持续音频分析,不再依赖固定关键词。系统通过流式ASR与意图识别模块实时判断用户是否在对设备说话,实现从“喊名字”到“自然交谈”的跨越-43。

6.2 全双工交互(Full-Duplex Interaction)

全双工指系统能够“边听边说”,实现类似于人类对话的自然交互。传统半双工系统依赖独立的VAD(Voice Activity Detection,语音活动检测)进行机械式音频切分,在用户停顿思考时容易被“误判为说完”而提前抢答-27。

2026年4月,字节跳动发布了Seeduplex原生全双工语音LLM,在复杂场景下的误回应率和误打断率相比半双工模型降低了一半,提前回应率下降了40%,并已在豆包App上完成规模化部署-27。这意味着全双工技术正式从实验室走向大规模商用。

6.3 边缘计算与云端协同(Hybrid Architecture)

现代语音AI系统普遍采用“云端+边缘”的分层架构:

边缘层:处理唤醒检测、简单指令执行,延迟接近零,保障隐私-46。

云端层:负责复杂推理、长上下文理解、多设备协同管理等深度任务-46。

这种“两脑协同”的混合架构,让系统既拥有边缘端的速度与隐私保障,又拥有云端的智能深度。

七、高频面试题与参考答案

面试题1:AI语音助手的核心工作流程是什么?请简述其架构。

参考答案:

AI语音助手的核心架构采用 ASR → LLM → TTS 的级联处理模式。用户语音输入后,ASR模块将其转换为文本,LLM模块理解语义并生成回复文本,TTS模块将回复文本合成为语音输出。为达到实时交互效果,三个模块需采用流式API并行处理,而非串行阻塞,端到端首音频延迟通常控制在1秒以内。

面试题2:什么是全双工语音交互?它相比半双工有什么优势?

参考答案:

全双工交互允许AI系统同时处理音频输入和输出,实现“边听边说”的自然对话节奏,而半双工系统遵循“听完→处理→说完”的串行模式-27。全双工的核心优势在于:(1)支持打断和插话,更接近人类对话体验;(2)通过联合利用语音特征和语义特征进行端点检测,能准确区分“停顿思考”与“说完结束”,避免抢答;(3)具备更强的抗干扰能力,可在复杂声学环境中准确过滤背景噪声-27。

面试题3:为什么语音AI系统需要边缘计算?边缘端和云端如何分工?

参考答案:

语音AI引入边缘计算主要是为了解决延迟、隐私和网络依赖三个问题。边缘端负责唤醒检测、简单指令执行等实时性要求高的任务,实现毫秒级响应;云端负责复杂推理、长上下文理解、多设备协同等深度任务-46。这种“混合架构”既保证了核心交互的即时性与数据隐私,又能调用云端大模型的强大理解能力。调查数据显示,44%的开发者选择混合构建方案-7。

面试题4:在构建实时语音助手时,系统延迟主要来自哪里?如何优化?

参考答案:

延迟主要来自三个环节:ASR识别耗时、LLM推理耗时、TTS合成耗时。优化的核心策略包括:(1)流式处理:三个模块采用流式API并行工作,边接收边处理,不等待完整音频或完整文本;(2)模块级加速:选用低延迟ASR(如Deepgram的150ms首帧时间)和低延迟TTS(如ElevenLabs的75ms以内)-9;(3)硬件加速:部署GPU(如NVIDIA A10G)加速LLM推理;(4)精简模型:在非关键场景使用小参数模型降低推理时间-10。

面试题5:级联架构和端到端架构在语音助手中各有什么优缺点?

参考答案:

级联架构优点:模块独立、技术成熟、可解释性强、便于调试替换;缺点:串行累积延迟、存在信息传递损失。端到端架构优点:统一建模、潜在延迟更低、能保留语气停顿等副语言信息;缺点:训练数据需求量约为级联方案的5-8倍、可解释性差、模型耦合度高-24。目前生产系统以级联架构为主,但端到端方案正快速演进,未来可能出现两者融合的趋势。

八、总结回顾

本文围绕AI结合语音助手这一2026年的核心技术主题,系统梳理了:

痛点驱动:传统关键词+规则引擎存在交互割裂、语义理解弱、无法多轮对话三大问题

核心概念:ASR(耳朵)→ LLM(大脑)→ TTS(嘴巴)的级联架构

架构对比:级联架构(模块化、成熟度高)vs 端到端架构(统一建模、延迟更低)

底层原理:唤醒词检测、全双工交互、边缘与云端协同

关键代码:模块化语音助手的Python实现

面试考点:5道高频面试题及标准答案

重点回顾:

现代AI语音助手的本质是 “ASR听写 → LLM理解 → TTS说话”的级联协同,而实时性的关键不在于任何一个模块有多快,而在于流式传输与流水线并行的工程能力。

AI结合语音助手正在从“锦上添花”走向“不可或缺”——55%的用户将“需要重复自己的话”列为最大使用痛点,而76%的开发者将ASR准确率视为成功的关键指标-7。未来2-5年内,语音AI代理将成为人机交互的主要界面,而赢家将是那些早期解决了基础用户体验问题的团队-7。

后续文章我们将深入探讨:如何利用Function Calling让语音助手真正“办事”、语音Agent的端侧部署与隐私保护方案、多语言/方言场景下的ASR优化策略。敬请期待!