北京时间 2026年4月9日

在人口老龄化浪潮与技术革新的交汇点上,AI养老助手正从实验室走向千家万户,成为缓解养老压力、提升晚年生活质量的关键技术方案。

一、开篇引入:为什么AI养老助手是当前必学技术

人工智能与养老服务的深度融合,正在重塑传统养老服务模式。根据最新数据,2025年中国60岁以上老年人口已达3.23亿,占总人口23%,银发经济市场规模约7万亿元,预计到2035年将突破30万亿元-11。智慧养老行业市场规模约为7.21万亿元,其中智慧养老设备行业规模约1840.8亿元-13。在政策、需求与技术三重驱动下,养老机器人产业迎来了爆发式增长-。

许多开发者在学习这一领域时存在明显的“断层”:会调用大模型API,却不理解多模态交互架构;能写语音识别代码,但搞不清楚意图识别与对话管理的协同机制;概念混淆——智能体(Agent)与数字人、虚拟助手与实体机器人之间的区别说不清。这些问题在技术面试中往往成为致命扣分点。

本文将系统梳理AI养老助手的核心技术栈,从架构设计→核心概念→代码实现→底层原理→面试考点逐层递进,帮你建立完整的知识链路。后续系列将深入大模型微调、边缘推理优化、隐私保护等进阶话题。

二、痛点切入:为什么需要AI养老助手

传统解决方案的局限性

在AI养老助手出现之前,传统助老方案主要依赖以下方式:

人工服务模式:

依赖护工、家属、社区工作者提供陪伴与照护

人力成本高:一线城市养老护理员月薪已达8000-12000元

服务质量不稳定:受人员流动、情绪、专业技能影响大

传统智能设备模式:

智能手环/手表:仅能监测心率、步数,无交互能力

一键呼叫设备:被动响应,无法主动关怀

固定脚本对话机器人:预定义回复模板,遇到非预设问题即卡死

传统脚本式对话的典型实现 def scripted_response(user_input): if "吃饭" in user_input: return "您想吃什么呢?" elif "吃药" in user_input: return "请按时服用药物。" else: return "我不太明白您的意思,请重新说一遍。" 卡死点

核心缺陷总结

| 维度 | 传统方式的问题 | 影响 |

|---|---|---|

| 灵活性 | 预定义模型,缺乏定制化AI生成角色 | 无法适配老人个性化需求-1 |

| 交互体验 | 单向指令,无情感识别与共情 | 老人使用意愿低,弃用率高 |

| 实时性 | 响应延迟高,云端处理无法保证实时交互 | 紧急场景响应不及时 |

| 学习成本 | 界面复杂、按钮细小 | 跨越“数字鸿沟”困难-11 |

| 可扩展性 | 功能固化,难以接入新服务 | 养老服务生态无法整合 |

AI养老助手的出现正是为了解决以上痛点,通过大语言模型(LLM)的自然语言理解能力、多模态感知技术、以及智能体(Agent)自主决策机制,实现从“被动工具”到“主动伴侣”的质变。

三、核心概念讲解(一):AI养老助手的定义与架构

3.1 标准定义

AI养老助手(AI-powered Eldercare Assistant)是指基于人工智能技术(包括大语言模型、计算机视觉、语音识别与合成、推荐系统等),面向老年群体提供健康监测、情感陪伴、生活辅助、安全预警等综合服务的智能化系统。

3.2 拆解关键词

AI-powered:以大模型和智能体为核心驱动引擎

Eldercare:服务场景限定于养老领域,包括居家、社区、机构三类形态-

Assistant:不仅仅是工具,更是主动理解需求、提供个性化服务的“助手”

3.3 生活化类比

可以把AI养老助手想象成一个“24小时不休息、永远耐心的私人护理管家”:

它能听到你说的话(语音识别)

能看懂你的表情和动作(计算机视觉)

能记住你的喜好和习惯(记忆系统)

能主动提醒你吃药、陪你聊天、帮你订餐(任务执行)

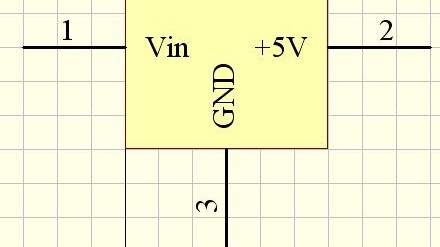

3.4 典型技术架构

当前主流的AI养老助手采用边缘计算+云端协同的分布式架构:

┌─────────────────────────────────────────────────────────┐ │ 端侧(边缘计算) │ │ ┌──────────┐ ┌──────────┐ ┌──────────┐ ┌──────────┐ │ │ │ 语音唤醒 │ │ 语音识别 │ │ 意图识别 │ │ 本地缓存 │ │ │ └────┬─────┘ └────┬─────┘ └────┬─────┘ └────┬─────┘ │ │ │ │ │ │ │ │ └───────────┴───────────┴───────────┘ │ │ │ │ │ ┌─────▼─────┐ │ │ │ 决策分发层 │ │ │ └─────┬─────┘ │ │ ┌───────────────┼───────────────┐ │ │ ▼ ▼ ▼ │ │ ┌──────────┐ ┌──────────┐ ┌──────────┐ │ │ │ 本地任务 │ │ 云端请求 │ │ 紧急通道 │ │ │ │(提醒等) │ │(复杂推理)│ │(异常告警)│ │ │ └──────────┘ └────┬─────┘ └──────────┘ │ └───────────────────────┼─────────────────────────────────┘ │ ▼ ┌─────────────────────────────────────────────────────────┐ │ 云端组件 │ │ ┌──────────┐ ┌──────────┐ ┌──────────┐ ┌──────────┐ │ │ │ 大语言模型│ │ 用户画像 │ │ 知识图谱 │ │ 数据存储 │ │ │ │ (LLM) │ │ 系统 │ │ 系统 │ │ 系统 │ │ │ └──────────┘ └──────────┘ └──────────┘ └──────────┘ │ └─────────────────────────────────────────────────────────┘

四、关联概念讲解(二):多智能体协同架构

4.1 标准定义

多智能体系统(Multi-Agent System, MAS)是指将复杂任务分解为多个独立AI智能体(Agent),每个Agent负责特定领域任务,通过协作机制完成整体目标的技术方案。

4.2 与AI养老助手的关系

AI养老助手是多智能体系统的典型应用场景。一个完整的养老助手通常包含以下智能体分工:

┌─────────────────────────────────────────────────────────────┐ │ 用户输入(语音/文字) │ └─────────────────────────────┬───────────────────────────────┘ │ ┌─────────────────────┼─────────────────────┐ ▼ ▼ ▼ ┌──────────────┐ ┌──────────────┐ ┌──────────────┐ │ 健康监测Agent │ │ 情感陪伴Agent │ │ 生活辅助Agent │ │ │ │ │ │ │ │· 体征数据分析 │ │· 情绪识别 │ │· 订餐/购物 │ │· 用药提醒 │ │· 主动对话 │ │· 出行规划 │ │· 异常预警 │ │· 记忆共鸣 │ │· 信息查询 │ └──────┬───────┘ └──────┬───────┘ └──────┬───────┘ │ │ │ └─────────────────────┼─────────────────────┘ ▼ ┌──────────────────────────┐ │ 仲裁器/融合器 │ │ (冲突解决+优先级排序) │ └──────────────────────────┘

4.3 实际案例:三智能体推荐系统

以开源的“SilverJourney AI”银发旅游助手为例,其核心设计采用了三个独立智能体-21:

三个智能体并行评分 @dataclass class HealthProfile: """用户健康画像""" age: int = 65 mobility_score: float = 3.0 行动能力1-5 chronic_diseases: List[str] = None 慢性病史 智能体1:健康评估Agent class HealthAgent: def evaluate(self, destination, user_profile): """评估目的地是否符合用户健康状况""" score = 0 if destination.steps <= user_profile.stamina_limit: score += 0.4 if destination.has_elevator or not destination.has_stairs: score += 0.3 if destination.nearby_hospital <= 5: 5公里内有医院 score += 0.3 return score 智能体2:安全评估Agent class SafetyAgent: def evaluate(self, destination): """评估目的地安全性(天气、医疗资源、人流密度)""" 低于2星自动过滤 return safety_score 智能体3:兴趣匹配Agent class InterestAgent: def evaluate(self, destination, user_history): """匹配用户历史偏好""" return interest_score 仲裁器:加权融合 class Moderator: def aggregate(self, scores, weights): """加权融合 + 安全兜底""" total = (scores['health'] weights['health'] + scores['safety'] weights['safety'] + scores['interest'] weights['interest']) return total

4.4 概念对比:智能体 vs 传统模块

| 维度 | 传统模块化设计 | 多智能体设计 |

|---|---|---|

| 独立性 | 功能耦合,修改一处影响全局 | Agent独立运行,可单独升级 |

| 扩展性 | 新增功能需修改核心代码 | 新增Agent即可,零侵入 |

| 容错性 | 单点故障可能导致系统崩溃 | Agent失效不影响其他功能 |

| 复杂度 | 代码逻辑集中,调试困难 | 每个Agent聚焦单一职责 |

五、概念关系与区别总结

一句话概括:AI养老助手是“顶层应用目标”,多智能体是“实现该目标的关键技术手段”。

┌─────────────────────────────────────────────────────────┐ │ AI养老助手(是什么) │ │ 顶层应用:陪伴 + 健康 + 生活 + 安全 │ └─────────────────────────────────────────────────────────┘ │ ▼ ┌─────────────────────────────────────────────────────────┐ │ 多智能体系统(怎么做) │ │ 实现手段:Agent分工 + 协作机制 + 仲裁器 │ └─────────────────────────────────────────────────────────┘

对比表:

| 对比维度 | AI养老助手 | 多智能体系统 |

|---|---|---|

| 定位 | 应用层产品/解决方案 | 技术架构/实现范式 |

| 范围 | 专注养老场景 | 通用技术,适用于任何复杂任务分解场景 |

| 组成 | 硬件+软件+服务 | 纯软件架构 |

| 核心价值 | 解决老年人生活痛点 | 解决复杂任务协同执行问题 |

六、代码/流程示例演示

6.1 一个完整可运行的养老对话助手示例

以下实现了一个基于LLM的养老对话助手核心模块:

完整可运行的AI养老助手核心模块 import openai from dataclasses import dataclass from typing import Optional, List import json 1. 用户画像配置(关键!个性化服务的核心) @dataclass class ElderlyProfile: user_id: str name: str age: int = 70 chronic_diseases: List[str] = None 慢性病史 medication_list: List[dict] = None 用药清单 interests: List[str] = None 兴趣偏好 emergency_contact: dict = None 紧急联系人 def to_context_string(self): """将用户画像转换为Prompt上下文""" context = f"【用户信息】姓名:{self.name},年龄:{self.age}岁。" if self.chronic_diseases: context += f"健康状况:患有{','.join(self.chronic_diseases)}。" if self.interests: context += f"兴趣偏好:喜欢{','.join(self.interests)}。" return context 2. 对话管理器 class EldercareDialogueManager: def __init__(self, api_key: str, model: str = "gpt-3.5-turbo"): openai.api_key = api_key self.model = model self.memory_window = 10 保留最近10轮对话作为短期记忆 def build_prompt(self, user_query: str, profile: ElderlyProfile, history: List[dict]) -> str: """构建包含用户画像和记忆的Prompt""" system_prompt = f"""你是一位专业的养老助手,服务于{profile.name}老人。 {profile.to_context_string()} 【重要规则】 1. 回答要温暖、耐心、语速适中 2. 涉及用药问题时,必须先询问是否已遵医嘱 3. 检测到用户情绪低落时,主动提供情感支持 4. 涉及健康紧急情况时,明确提示联系紧急联系人 5. 不要使用复杂词汇,避免反问句 【历史对话】 {self._format_history(history)} 【用户当前问题】 {user_query} 请回复:""" return system_prompt def _format_history(self, history: List[dict]) -> str: formatted = [] for h in history[-self.memory_window:]: formatted.append(f"用户:{h['user']}\n助手:{h['assistant']}") return "\n".join(formatted) def chat(self, user_query: str, profile: ElderlyProfile, history: List[dict]) -> str: """核心对话处理逻辑""" 第一步:意图识别与安全检测 if "吃药" in user_query and profile.medication_list: 命中用药提醒场景,走特殊处理逻辑 return self._handle_medication_query(user_query, profile) 第二步:构建Prompt调用LLM prompt = self.build_prompt(user_query, profile, history) 第三步:调用大模型生成回复 try: response = openai.ChatCompletion.create( model=self.model, messages=[{"role": "user", "content": prompt}], temperature=0.7, 控制回复多样性 max_tokens=500 ) return response.choices[0].message.content except Exception as e: 降级方案:返回预定义安全回复 return "抱歉,我暂时无法回答这个问题。建议您联系家人或拨打紧急电话。" def _handle_medication_query(self, query: str, profile: ElderlyProfile) -> str: """用药提醒场景专用处理""" 检查是否需要紧急提醒 return "请问您按时服用药物了吗?如果不确定,请先查看药盒上的说明,或联系医生确认。" 3. 主程序演示 if __name__ == "__main__": 初始化 manager = EldercareDialogueManager(api_key="your-api-key") 创建用户画像(示例:75岁高血压患者) profile = ElderlyProfile( user_id="1001", name="王奶奶", age=75, chronic_diseases=["高血压", "关节炎"], medication_list=[{"name": "硝苯地平", "time": "07:00"}], interests=["京剧", "广场舞"], emergency_contact={"name": "张明", "phone": "1380000"} ) history = [] 测试对话 user_queries = [ "我今天血压有点高,怎么办?", "我想听一段京剧", "这个降压药什么时候吃最好?" ] for query in user_queries: print(f"\n【用户】{query}") response = manager.chat(query, profile, history) print(f"【助手】{response}") history.append({"user": query, "assistant": response})

6.2 代码执行流程图解

用户输入 │ ▼ ┌─────────────────────────────────────────┐ │ 1. 接收语音/文字输入 │ └───────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────┐ │ 2. 意图识别 │ │ ├── 用药提醒场景?→ 特殊处理路径 │ │ └── 普通对话场景?→ LLM路径 │ └───────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────┐ │ 3. 构建Prompt │ │ ├── 注入用户画像(慢性病、用药等) │ │ ├── 注入对话历史(短期记忆) │ │ └── 注入行为规则(安全约束) │ └───────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────┐ │ 4. 调用LLM生成回复 │ └───────────────┬─────────────────────────┘ ▼ ┌─────────────────────────────────────────┐ │ 5. 后处理:安全过滤 + 语音合成 │ └─────────────────────────────────────────┘

七、底层原理/技术支撑点

7.1 技术栈全景

┌─────────────────────────────────────────────────────────┐ │ 应用层 │ │ 情感陪伴 | 健康监测 | 生活辅助 | 安全预警 | 用药提醒 │ └─────────────────────────────────────────────────────────┘ │ ┌─────────────────────────────────────────────────────────┐ │ 能力层 │ │ LLM对话 | 语音识别ASR | 语音合成TTS | 计算机视觉CV │ │ 推荐系统 | 知识图谱 | 情绪识别 | 姿态识别 │ └─────────────────────────────────────────────────────────┘ │ ┌─────────────────────────────────────────────────────────┐ │ 支撑层 │ │ 边缘计算 | 云端协同 | 分布式存储 | 数据安全加密 │ └─────────────────────────────────────────────────────────┘

7.2 关键底层技术详解

| 技术 | 在AI养老助手中的作用 | 典型实现 |

|---|---|---|

| 大语言模型(LLM) | 核心对话引擎,负责语义理解和回复生成 | GPT系列、通义千问、文心一言 |

| 自动语音识别(ASR) | 将老人语音转为文字 | Whisper、自研ASR |

| 文本转语音(TTS) | 将回复文字转为自然语音 | CosyVoice、VITS |

| 计算机视觉(CV) | 老人微表情识别、跌倒检测、姿态分析 | 多模态大模型 |

| 推荐系统(RecSys) | 个性化内容与服务推荐 | 协同过滤+深度学习 |

| 边缘计算 | 保障实时响应,本地处理敏感数据 | 国产算力异构平台- |

| 知识图谱(KG) | 构建老人个性化认知图谱 | Neo4j+LLM结合 |

7.3 底层原理简述

以LLM驱动的对话为例,其核心原理可概括为:

通过在海量文本上进行预训练,模型学习到了语言的统计规律和世界知识;在推理时,将用户输入与上下文拼接,模型基于自注意力机制(Self-Attention)逐字生成最可能的回复序列。

关键机制包括:

自注意力:让模型在生成每个词时,能“关注”到输入中最重要的部分

位置编码:让模型理解词语之间的顺序关系

层归一化+残差连接:保证深层网络训练的稳定性

温度参数(Temperature):控制生成结果的随机性,温度越低回复越确定性

后续进阶内容将深入LLM微调技术(LoRA、QLoRA)、Agent规划机制(ReAct、CoT)等,敬请关注。

八、高频面试题与参考答案

Q1:设计一个AI养老助手,你会采用什么架构?为什么?

参考答案(踩分点:分层架构+边缘协同):

我会采用边缘计算+云端协同的四层架构:

端侧感知层:部署轻量级ASR模型(如Whisper-tiny)实现本地语音唤醒和识别,降低延迟

边缘决策层:处理简单任务(定闹钟、查天气),采用规则引擎+轻量级分类器,响应时间控制在200ms内

云端推理层:复杂任务(情感对话、健康分析)调用大模型API,采用异步请求+本地缓存优化

数据管理层:用户敏感数据(健康档案)加密存储在本地,匿名化行为数据上传云端用于模型迭代

设计理由:兼顾实时性(紧急场景需秒级响应)、安全性(医疗数据不上云)、以及大模型能力(复杂推理靠云端)。

Q2:LLM驱动的对话和传统脚本对话有什么区别?各有什么优缺点?

参考答案:

| 维度 | LLM对话 | 脚本对话 |

|---|---|---|

| 灵活性 | 极高,可处理任意开放域问题 | 极低,仅限预定义场景 |

| 开发成本 | 高(算力+API费用) | 低(规则配置即可) |

| 可控性 | 低,存在幻觉和偏离风险 | 高,输出完全可控 |

| 响应延迟 | 高(1-3秒) | 低(<100ms) |

| 个性化 | 可结合用户画像动态适配 | 需要手动编写大量分支 |

最佳实践:混合策略——常见问题走脚本快速响应,开放域问题走LLM,安全敏感问题(用药、紧急状况)强制走规则路径。

Q3:什么是AI Agent?它在养老场景中如何应用?

参考答案(踩分点:自主性+工具使用+目标导向):

AI Agent是以大模型为“大脑”,具备自主感知环境、制定计划、调用工具、执行任务并持续学习能力的智能体-21。

在养老场景中的典型应用:

任务编排Agent:当用户说“我要去医院复诊”,Agent自动拆解任务——预约挂号→查询路线→叫车→设置用药提醒→复诊后追踪

健康监测Agent:持续分析心率、血压数据,异常时主动触发预警,而不是被动等待用户提问

安全守护Agent:结合毫米波雷达跌倒检测和LLM对话上下文,判断老人是否需要紧急救援

核心差异:传统模块是“被动响应”,Agent是主动规划+执行闭环。

Q4:如何处理养老场景中的敏感数据隐私问题?

参考答案(踩分点:本地化+匿名化+合规):

边缘计算优先:个人身份信息、健康档案、语音对话内容在端侧处理,不上传云端-2

差分隐私:云端训练数据添加噪声,保证无法反推个体信息

数据最小化原则:只采集完成任务所需的最小数据集

用户授权机制:克隆声音、生成数字人等需明确授权-47

合规框架:遵循《个人信息保护法》、HIPAA(如涉及医疗数据)等法规

Q5:养老场景中LLM的“幻觉”问题如何规避?

参考答案:

RAG架构:涉及健康、用药等关键信息时,强制检索知识库,不依赖模型记忆

安全规则层:在LLM输出前加一层规则过滤,检测是否包含危险建议

关键领域冻结:对用药提醒、急救指导等高风险场景,完全走脚本化路径,不使用LLM生成

置信度阈值:LLM低置信度输出时,降级为“我不确定,建议联系医生/家人”

人工复核:异常对话记录保存,定期抽检复核

九、结尾总结

核心知识点回顾

AI养老助手的定义:面向老年群体提供健康、陪伴、生活、安全综合服务的智能化系统

核心架构:边缘计算+云端协同的四层架构(感知层→决策层→推理层→数据层)

关键技术:LLM(对话引擎)+ ASR/TTS(语音交互)+ CV(视觉感知)+ Agent(任务编排)

概念辨析:AI养老助手是“应用目标”,多智能体是“实现手段”

隐私与安全:医疗数据本地化、差分隐私、安全规则层兜底

重点强调

易错点:不要将所有任务都丢给大模型——简单任务走本地规则可降低95%的成本和延迟

易混淆点:Agent(自主规划执行)≠ 大模型API调用(被动问答)

学习路径建议:先掌握LLM API基础调用 → 学习Prompt工程 → 理解Agent架构 → 实践边缘部署优化

预告

下一篇将深入讲解AI养老助手中的大模型微调技术,包括LoRA高效微调、领域数据构建策略、以及边缘端量化部署实战,帮助你将通用模型“专精”到养老服务领域。

本文数据来源:2026年《政府工作报告》数据、华经产业研究院智慧养老报告、工信部/民政部政策文件、相关学术论文及开源项目。