手机拍夜景糊成一片、逆光人像黑成一团、构图总是歪七扭八……这些问题你遇到过吗?如今,AI相机助手正以深度学习、多模态感知与边缘计算为核心,悄然将手机摄像头从“被动记录工具”升级为“主动创作伙伴”。它不仅是影像领域的新宠,更是AI技术入门/进阶学习者和相关技术栈开发工程师必须掌握的知识点——只会按快门却不懂背后原理,面试时一问三不知,正是很多人的真实写照。本文将从技术痛点切入,系统讲解AI相机助手的核心概念、底层原理与开发落地,并附代码示例和高频面试题,帮你建立完整知识链路。

一、痛点切入:传统相机模式为何“拖后腿”?

先看一段传统相机调参的典型流程:

传统模式:用户手动调整参数def traditional_camera(): iso = input("请手动设置ISO(100-3200):") shutter = input("请手动设置快门速度(1/1000-1/30):") focus = input("请手动设置对焦模式(AF/MF):") 全部依赖用户决策 return capture(iso, shutter, focus)

这种方式的三个硬伤:

门槛高:普通用户分不清ISO、光圈、快门,拍出“废片”是常态。

调参慢:抓拍瞬间来不及调整参数,错失最佳画面。

无场景感知:同一个设置拍风景和拍人像效果天差地别,相机却毫不知情。

移动影像正处于从“记录真实”向“智慧感知”跨越的关键节点-2。正是在这样的背景下,AI相机助手应运而生。

二、核心概念讲解:什么是AI相机助手?

AI相机助手(AI Camera Assistant),指将深度学习、计算机视觉和多模态感知技术集成到相机系统中,自动完成场景识别、参数优化、图像增强和智能创作的智能摄影系统-4。

用一句话说:它让相机“看懂”你在拍什么,然后帮你“拍好”。

可以用三个层次来拆解其内涵:

| 层次 | 功能 | 生活化类比 |

|---|---|---|

| 感知层 | 自动识别拍摄场景、主体、光线 | 像有经验的摄影师“先看再拍” |

| 决策层 | 动态调整曝光、对焦、白平衡等参数 | 像专业的调参师“一键匹配” |

| 生成层 | AI修复缺陷、增强画质、风格迁移 | 像后期修图师“帮你精修” |

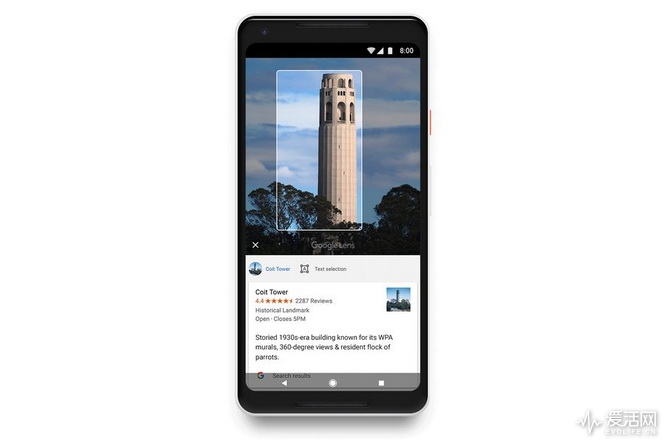

三星对此给出了简洁定义:AI相机就是人工智能在摄影过程中提供帮助的相机——利用机器学习自动识别拍摄主体并调整设置,使其呈现最佳效果-4。2026年3月,vivo在MWC大会发布了行业首个端侧实时相机AI Agent,标志着AI相机助手已从“规则算法”迈入“智能体”时代-2。

三、关联概念讲解:多模态大模型与AI相机的“化学反应”

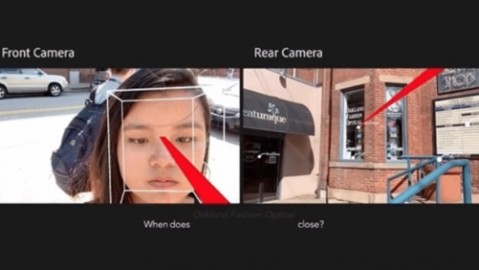

多模态大模型(Multi-modal Large Model,MLM)指能够同时处理和理解文本、图像、音频、视频等多种模态数据的AI模型,通过跨模态对齐实现比单模态更丰富、更精准的场景理解。

它与AI相机助手的关系是:多模态大模型是AI相机助手的“大脑升级包” 。传统AI相机只能做“单模态图像识别”,而多模态大模型可以实现视觉、文本、语义、规则的深度融合,能够像人一样进行思考-26。

二者的对比如下:

| 维度 | 传统AI相机 | 多模态大模型赋能后的AI相机助手 |

|---|---|---|

| 识别能力 | 只能识别物体 | 能理解场景语义、空间关系 |

| 决策依据 | 图像特征匹配 | 融合文本描述、上下文规则 |

| 典型输出 | “检测到安全绳” | “该人员正在进行登高作业,违规未系安全绳” |

举例来说:传统AI相机拍到火花,只会告警“发现火情”。但多模态大模型能判断“这是动火作业区、周边有灭火装置、属于合规操作”——误报率可下降95%以上-26。

四、概念关系与区别总结

一句话概括二者逻辑关系:AI相机助手是“目标”,多模态大模型是“加速器”;前者定义“要做什么”,后者决定“能做多好”。

AI相机助手:聚焦摄影场景,强调端到端的用户价值

多模态大模型:跨场景通用,提供更强大的感知与推理能力

关系:多模态能力是AI相机助手实现“场景认知”的关键技术路径

五、代码示例:用ML Kit + CameraX打造你的首个AI相机助手

以Android平台为例,使用Google的ML Kit(Machine Learning Kit)视觉API和CameraX库,只需少量代码即可实现设备端AI推理——图像数据无需上传云端,保障隐私的同时实现毫秒级响应-50。

// 1. 添加依赖 (app/build.gradle) dependencies { implementation "com.google.mlkit:object-detection:latest-version" implementation "androidx.camera:camera-camera2:1.5.3" implementation "androidx.camera:camera-lifecycle:1.5.3" } // 2. 初始化对象检测器 val detector = ObjectDetection.getClient( ObjectDetectorOptions.Builder() .setDetectorMode(ObjectDetectorOptions.STREAM_MODE) .build() ) // 3. 从CameraX获取图像帧并执行推理 imageAnalysis.setAnalyzer( Executors.newSingleThreadExecutor() ) { imageProxy -> val mediaImage = imageProxy.image if (mediaImage != null) { val inputImage = InputImage.fromMediaImage(mediaImage, imageProxy.imageInfo.rotationDegrees) detector.process(inputImage) .addOnSuccessListener { detectedObjects -> // 检测到物体后,自动优化相机参数 detectedObjects.forEach { obj -> when (obj.labels.firstOrNull()?.text) { "Person" -> setOptimizedParams("portrait") "Food" -> setOptimizedParams("food") else -> setOptimizedParams("auto") } } } .addOnFailureListener { e -> Log.e("AI Camera", "Detection failed", e) } .addOnCompleteListener { imageProxy.close() } } }

执行流程拆解:

CameraX捕获实时图像帧

将图像传入ML Kit对象检测器

模型推理返回检测结果(物体类别、置信度、位置)

根据检测结果动态调用

setOptimizedParams()自动调参整个过程在设备端完成,无需联网

这个极简示例展示了AI相机助手最核心的能力闭环:看 → 识别 → 调参 → 拍摄。实际产品中,识别模型和调参逻辑会更加复杂,但本质相通。

六、底层原理与技术支撑

AI相机助手的底层技术栈是一个从硬件到算法的完整金字塔:

硬件层:专用AI计算单元。2025年的高端手机SoC普遍集成了NPU(神经网络处理单元,Neural Processing Unit)。例如,Bee Edge AI平台使用5.1 TOPS算力的NPU直接运行检测模型-1。Arm最新推出的SME2(Scalable Matrix Extension 2)指令集扩展,让CPU也能高效执行神经图像降噪,实时处理能力显著提升-40。

模型层:轻量化深度学习模型。MobileNet、EfficientNet等专为移动端设计的架构,在毫瓦级功耗下完成实时推理。

框架层:端侧推理引擎。如ML Kit、TensorFlow Lite(TFLite)、NNAPI(Android神经网络API,Neural Networks API)等,负责模型转换、量化、加速。

系统层:并行处理架构。现代移动相机的图像信号处理(ISP,Image Signal Processor)已从传统的串行单帧处理演进为多帧并行+AI辅助的混合架构,AI模型与ISP协同工作,按下快门前就在预览阶段完成场景分析和优化-5。

理解这一技术栈,能帮助你清晰定位自己在整个生态中的发力点:是做硬件加速、模型优化,还是应用开发。

七、高频面试题与参考答案

Q1:什么是AI相机助手?请简要说明其核心功能。

AI相机助手是将深度学习、多模态感知与相机系统深度集成的智能摄影方案,核心功能包括:①场景智能识别(自动识别主体和光线环境);②参数自动优化(动态调整ISO、快门、对焦等);③画质AI增强(降噪、HDR、色彩校正);④AIGC创作(图像修复、风格迁移、多图合成)。

Q2:AI相机助手如何实现低延迟、高隐私保护的实时推理?

核心策略是端侧推理(On-device Inference)——将AI模型部署在设备端的NPU或GPU上运行,无需上传云端-50。关键技术包括:①模型量化(FP32→INT8,减小体积和计算量);②硬件加速(NPU/GPU/SME2指令集);③流水线优化(CameraX + ML Kit Analyzer无缝衔接采集与推理)--40。

Q3:多模态大模型如何赋能AI相机助手?

多模态大模型突破了传统“单模态图像识别”的局限,让AI相机实现从“感知”到“认知”的跨越-26。它融合视觉、文本、语义和规则,能够理解“动火作业”“登高作业”等业务上下文,实现基于规则的合规判断和风险预警,误报率可下降95%以上。

Q4:传统ISP架构与AI相机架构的核心差异是什么?

传统ISP基于串行单帧处理——RAW图经去马赛克、降噪、色彩校正后一次性输出。AI相机采用多帧并行+AI协同架构——多帧数据持续输入,AI模型分析场景后动态调整ISP配置,各模块多次迭代优化,最终输出最优图像-5。

Q5:如何在Android项目中快速集成端侧AI视觉能力?

推荐Google ML Kit + CameraX组合:CameraX管理相机生命周期和图像帧捕获,ML Kit提供开箱即用的视觉API(物体检测、文字识别、人脸检测等),两者无缝集成,且完全在设备端运行,开发效率高、隐私保护好-50。

八、结尾总结

本文围绕AI相机助手,梳理了以下核心要点:

痛点:传统相机门槛高、调参慢、无感知

概念:AI相机助手 = 场景识别 + 参数优化 + 图像增强

关系:AI相机助手是目标,多模态大模型是实现路径

示例:ML Kit + CameraX 5分钟搭建端侧AI推理

原理:硬件NPU + 轻量化模型 + 并行ISP架构

考点:端侧推理、多模态融合、ISP演进、ML Kit集成

一句话记考点:AI相机助手的本质,是将AI推理能力嵌入相机全链路,从感知到决策再到生成,全方位降低摄影门槛。

需要特别注意:AIGC生成内容依赖云端算力时,无网络环境会导致效果大幅下降-8。在设计AI相机助手时,优先采用端侧推理是保证稳定性和隐私安全的关键选择。

理解了AI相机助手,你就掌握了移动端AI落地最重要的应用场景之一。后续文章我们将深入探讨端侧大模型的量化压缩技术和多模态感知在AR场景中的应用,敬请期待!